Kako je Pentagon odrezal podjetje, ki se ni uklonilo agresivni viziji

Ameriško obrambno ministrstvo ne dovoli nikakršne regulacije uporabe umetne inteligence, niti ko to želijo in svetujejo razvijalci sami.

Umetno inteligenco smo v zadnjih letih spoznali predvsem v obliki klepetalnikov, kot so ChatGPT, Claude in Gemini, ki nam pojasnjujejo stvari, nudijo nasvete, pišejo e-pošto, že to pa jim pogosto povzroča halucinacije. Toda velike načrte za tehnologijo ima tudi ameriški obrambni minister Pete Hegseth, ki mu ni všeč, ko razvijalci želijo postaviti precej skromne meje glede vojaške rabe umetne inteligence.

To je pokazal odprti spor med Pentagonom in start upom Anthropic, ki je razvil model Claude. Anthropic je bil osrednji ponudnik umetne inteligence za vojno ministrstvo, a se konec februarja ni uklonil zahtevi o neovirani rabi njihovega modela. Hegseth in njegov predsednik Donald Trump sta podjetje kaznovala tako, da sta ga razglasila za tveganje v dobavni verigi in prepovedala uporabo Clauda vsem zveznim agencijam. Takšnega ukrepa so bila doslej deležna le tuja podjetja, na primer kitajski Huawei v letu 2018.

Anthropicovo pogodbo, vredno do 200 milijonov dolarjev, je nemudoma prevzel glavni tekmec in lastnik ChatGPT-ja OpenAI, ki je naknadno prav tako zahteval nekaj omejitev. Anthropic je proti Pentagonu vložil tožbo in pričakuje večmilijardni izpad dohodkov v 2026, saj zaradi označbe ministrstva tudi druga podjetja, ki sodelujejo z državo, čakajo z naročili pri Anthropicu.

Zaplet je nenavaden. Če smo vajeni, da se zasebna tehnološka podjetja v ZDA praviloma otepajo poskusov regulacije s strani države, je tokrat ravno nasprotno: država je tista, ki zahteva neovirano uporabo umetne inteligence za vojaške namene, medtem ko podjetjem grozijo ostri povračilni ukrepi, če uporabo njihove tehnologije skušajo regulirati sama.

Razvijalci umetne inteligence tudi pogosto apelirajo na odločevalce, naj vzpostavijo ustrezne varovalke za tehnologijo, ki po njihovih besedah še ni pripravljena za prav vsakršno uporabo v tako imenovani “verigi ubijanja” (kill chain, angl.).

“Vsakršna zakonita raba”

Ameriško obrambno ministrstvo v okrožnici o strategiji umetne inteligence z dne 9. januarja med drugim določa, da mora ministrstvo “uporabljati modele brez uporabniških omejitev, ki bi lahko omejevale legalne vojaške aplikacije”. Vse pogodbe s ponudniki storitev umetne inteligence morajo zato vključevati pravilo, da jih Pentagon lahko uporablja za “vsakršno zakonito rabo” (any lawful use, angl.).

Okrog slednje fraze se kreše spor med Anthropicom in Pentagonom, ki se je začel konec januarja, ko je Pentagon od ponudnikov umetne inteligence, s katerimi sodeluje, zahteval skladnost s to usmeritvijo. Dokončno je izbruhnilo 27. februarja, ko je Anthropic uradno zavrnil zahtevo ministrstva, ministrstvo pa je isti dan dalo Anthropic na črni seznam in pogodbo podelilo OpenAI.

Glavni izvršni direktor Anthropica Dario Amodei je dan pred zavrnitvijo zahteve v izjavi za javnost pojasnil, kakšne so meje dolgoletnega partnerja Pentagona. Anthropic ne dovoljuje uporabe svojih modelov za množični nadzor ameriških državljanov ali za upravljanje popolnoma avtonomnega orožja. To po Amodeijevih besedah doslej ni oviralo sodelovanja z obrambnim ministrstvom, ki ga je Trumpova administracija preimenovala v vojno ministrstvo (Department of War, angl.).

Anthropic kot zasebno podjetje ne želi posegati v vojaške odločitve ministrstva, je dejal Amodei. Toda “v ozkem naboru primerov menimo, da lahko umetna inteligenca spodkopava demokratične vrednote, namesto da bi jih branila. Nekatere uporabe so preprosto zunaj meja tega, kar današnja tehnologija lahko varno in zanesljivo počne,” je zapisal.

Sistemi niso dovolj zanesljivi

Amodei pravi, da domači nadzor z umetno inteligenco ni “skladen z demokratičnimi vrednotami”. Pri tem izrecno poudari besedo “domači” – množičnega nadzora z umetno inteligenco izven ZDA ne omenja. Kar se tiče avtonomnega orožja, šef Anthropica vidi delno avtonomna orožja kot “ključna za zaščito demokracije”, popolnoma avtonomna orožja pa bi se po njegovem mnenju lahko v prihodnosti izkazala za pomembna pri nacionalni varnosti.

“Toda danes vodilni sistemi umetne inteligence preprosto niso dovolj zanesljivi za upravljanje popolnoma avtonomnega orožja. Zavestno ne bomo zagotavljali izdelka, ki bi ogrozil ameriške vojake in civiliste,” je dejal Amodei.

Odstranitev Anthropica se sicer izkazuje za bolj zahtevno, kot si želi Hegseth. Kot je pred dnevi poročal Reuters, se temu upirajo programerji na ministrstvu, ki Claude opisujejo kot najboljšega izmed vodilnih modelov umetne inteligence. Osebje naj bi v nekaterih primerih zavlačevalo z zamenjavo Clauda v upanju, da bo prišlo do spremembe politike. Ministrstvo poleg Clauda preizkuša tudi modele drugih večjih ponudnikov iz Silicijeve doline, kot so ChatGPT, Googlov Gemini in xAI-jev Grok.

Enoletno pogodbo z ministrstvom je Anthropic oznanil julija lani in kmalu postal prvi model, ki je bil lansiran na zaupnem omrežju Pentagona. Ameriška vojska je model uporabila v napadih na Iran, so poročali mediji, po navedbah Wall Street Journala tudi pri zajetju venezuelskega predsednika Nicolasa Madura.

Kot da bi bili v vojni

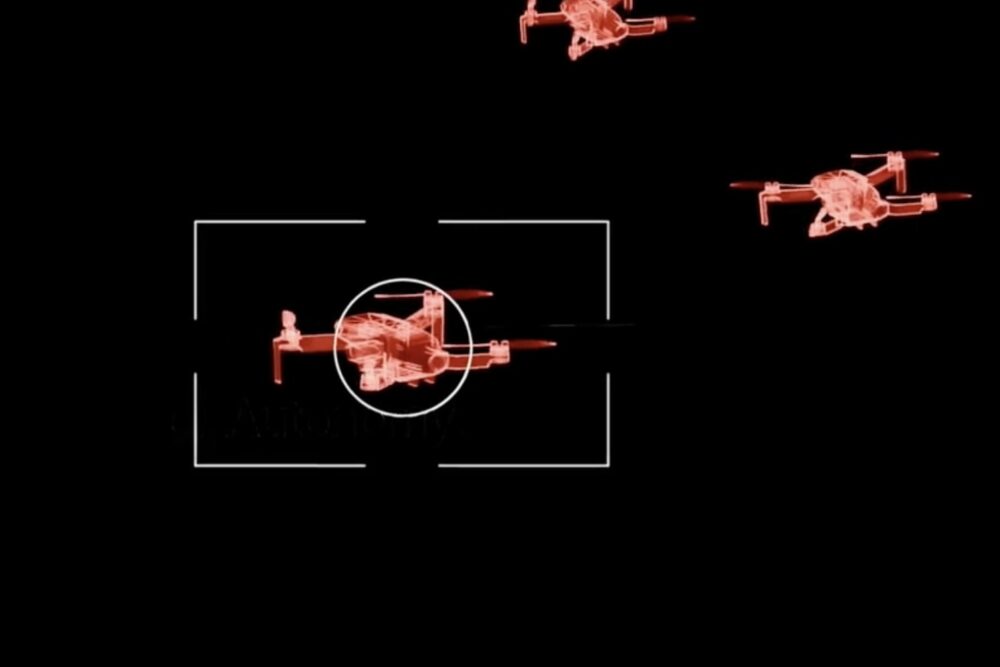

Omejitvi podjetja sta očitno v nasprotju s Hegsethovo strategijo, ki pravi, da se “moramo kompromisov glede tveganj, ‘pravičnosti’ in drugih subjektivnih vprašanj lotiti, kot da bi bili v vojni”. Za dosego ameriške vojaške prevlade v dobi umetne inteligence Trumpova administracija med ključnimi projekti navaja na primer projekt “Swarm Forge”, ki stremi k razvoju, testiranju in skaliranju novih načinov bojevanja z in proti zmogljivostim umetne inteligence. Pri tem je bolj pomembna hitrost razvoja kot “tveganja nepopolnih uskladitev”.

Izdelovalci orožja za ameriško vojsko, od tradicionalnih Lockheed Martina, Boeinga in RTX do novejših podjetij, kot sta Palantir in Anduril, že razvijajo roje avtonomnih dronov, ki jih upravlja umetna inteligenca, ali z umetno inteligenco povezana avtonomna bojna letala.

Pentagon od leta 2017 vodi projekt Maven, ki združuje podatke iz dronov, satelitov in drugih senzorjev za označevanje potencialnih tarč, predstavitev izsledkov človeškim analitikom in posredovanje njihovih odločitev operativnim sistemom. V sistemu je kot izvajalec sodeloval Google, ki je zaradi internega nasprotovanja izstopil, še vedno pa sodelujejo Anduril, Palantir, Amazon in do nedavnega Anthropic.

Za zdaj popolnoma avtonomno orožje, ki pri bojnih odločitvah ne bi potrebovalo človeka, še ni bilo preizkušeno v boju. Mnoge države so izrazile nasprotovanje razvoju takšnih sistemov, tudi EU opozarja na vključenost ljudi v odločanje.

V okrožnici Pentagona pa piše, da je treba “dati na stran tradicionalne pristope k bojevanju in zagotoviti, da to disruptivno tehnologijo uporabimo za povečanje smrtonosnosti naše vojske”.

OpenAI takoj prevzel posel

OpenAI se ni obotavljal pri prevzemu Anthropicove pogodbe in s tem izzval jezo tako mnogih uporabnikov, ki so s svojih naprav brisali ChatGPT, kot zaposlenih, ki se jim je zdelo, da je bil posel preuranjen in slabo premišljen. Anthropicov klepetalnik Claude je po zavrnitvi zahteve Pentagona prehitel ChatGPT po številu prenosov v Applovi trgovini aplikacij App Store.

Glavni izvršni direktor OpenAI Sam Altman je takoj po podpisu pogodbe na omrežju X zatrdil, da so tudi v njihovo pogodbo vključene varovalke. V zapisu je dejal, da sta dve najpomembnejši varnostni načeli podjetja prepoved množičnega nadzora Američanov in človeška odgovornost pri uporabi sile, kar vključuje prepoved povsem avtonomnega orožja.

Sprva zato ni bilo jasno, na kakšen način se pogodba razlikuje od Anthropicove. Zaradi nasprotovanja je OpenAI zahteval tudi nekatere popravke, na katera je ministrstvo očitno pristalo.

Dva dni po podpisu je prišlo bolj podrobno pojasnilo. Po popravkih je v pogodbi zapisano, da se “sistemi umetne inteligence ne smejo namerno uporabljati za nadzor oseb iz ZDA in državljanov” niti za “samostojno usmerjanje avtonomnega orožja, kadar zakon, predpis ali politika ministrstva zahteva človeški nadzor”.

Obenem pogodba uporablja tudi dikcijo ministrstva o vsakršni zakoniti rabi. “Ministrstvo za obrambo lahko uporablja sistem umetne inteligence za vse zakonite namene, skladno z veljavno zakonodajo, operativnimi zahtevami ter uveljavljenimi varnostnimi in nadzornimi protokoli.”

Here is re-post of an internal post:

— Sam Altman (@sama) March 3, 2026

We have been working with the DoW to make some additions in our agreement to make our principles very clear.

1. We are going to amend our deal to add this language, in addition to everything else:

"• Consistent with applicable laws,…

Altman se je posul s pepelom

“Menimo, da ima naš sporazum več varovalk kot kateri koli prejšnji sporazum za uvajanje tajne umetne inteligence, vključno z Anthropicovim,” je sporočil OpenAI. Pri tem se podjetje sklicuje na “tri rdeče črte”, ki so po njihovih navedbah vključene v pogodbo. Poleg obeh, ki ju je navedel že Anthropic, vključuje še prepoved uporabe umetne inteligence za avtomatizirane odločitve z visokim tveganjem, na primer v sistemih družbenih kreditov, kot je kitajski, ki ocenjuje posameznike na podlagi družbene koristi.

Popravljena pogodba sedaj preprečuje tudi uporabo OpenAI-jevega modela za obveščevalne agencije, ki so del ministrstva, kot je Agencija za nacionalno varnost (NSA).

Toda kakšna je potem razlika? Pri OpenAI menijo, da je njihove rdeče črte lažje zagotoviti kot Anthropicove, saj je uvajanje tehnologije omejeno na oblak (procesiranje podatkov na daljavo v podatkovnih centrih) in ne na robno računalništvo (lokalizirano procesiranje podatkov na napravah). Obenem so dejali, da ne vedo, zakaj Anthropic ni uspel doseči dogovora z ministrstvom.

Tudi če bi vlada spremenila zakone in pravilnike, pri OpenAI pravijo, da se omejitve nanašajo na zakone, ki so v veljavi danes, zato bi njihove varovalke še vedno veljale v trenutni obliki. Ministrstvo naj bi podjetju zagotovilo, da tehnologije ne nameravajo uporabljati za nedovoljene namene. Obenem bi v primeru vladne kršitve teh omejitev lahko pogodbo prekinili, pojasnjujejo.

Altman je v zapisu na X tudi priznal napako, da je tako hitro sprejel prvotni dogovor s Pentagonom, ki ga je opisal kot “oportunističnega in površnega”. Na sestanku z zaposlenimi pri OpenAI pred objavo tega zapisa je sicer direktor dejal, da podjetje nima nadzora nad tem, kako bo ministrstvo uporabilo njihovo tehnologijo, so poročali ameriški mediji.

Novo tveganje

OpenAI in ameriški tehnološki velikani, kot sta Microsoft in Amazon, so dejali, da Anthropic ne bi smel biti označen kot tveganje v dobavni verigi. Ministrstvo pa medtem stopnjuje pritisk na Anthropic. Podsekretar na Pentagonu Emil Michael je pred dnevi kot tveganje za nacionalno varnost izpostavil visoko število tujih zaposlenih v podjetju, tudi državljanov Kitajske.

Čeprav imajo tuje delavce tudi drugi vodilni ameriški laboratoriji, ki prav tako v veliki meri novačijo kitajske talente, je tam po mnenju ministrstva tveganje manjše, ker imajo ti ponudniki “tehnična in varnostna zagotovila vodstva, skupaj z njihovim dosledno odgovornim in zaupanja vrednim vedenjem”.